先日、Appleに関するニュースがIT界隈を騒然とさせました。新しいiPhoneやiPadが発表されたわけではありません。それは「AppleがiOS 15にiPhone内の画像を検閲する機能を導入する」といった内容でした。

ニュースタイトルを見た瞬間にはにわかに信じがたく「どうせセンセーショナルなタイトルでPVを稼ぎたいだけだろう」とライター特有の穿った気持ちで記事を読んでみれば、内容はほぼ上記のままで、Appleが米国内における子どもへの性的虐待などを防止する目的として、iPhoneなどの端末内の児童ポルノ画像を自動検出するAI技術「NeuralHash」を実用化するというものでした。

結論から言えばこれには若干の語弊があり、iPhone内の画像をiCloud上へアップロード(同期)しようとした際にチェック機能が働き、米国の全米行方不明・被搾取児童センター(NCMEC)が管理(確認)している児童ポルノ画像などと合致した場合にカウントされ、そのカウントが一定の閾値を越えた場合にApple内部の人間による確認を得た上でアカウントの停止やNCMECへの報告が成される、というものでした(詳細は後述)。

いわゆる「端末内のすべての画像を監視する」といった極端なシステムではなかったとは言え、これまでAppleは個人のプライバシーを最優先する方針を貫いてきただけに、このような手法を取ってきたことはかなりの衝撃でした。

Appleはなぜ多くの人々から非難されるほどに一歩踏み込んだ「検閲」を行うのでしょうか。そしてそれはテクノロジーの使い方として正しいのでしょうか。感性の原点からテクノロジーの特異点を俯瞰する連載コラム「Arcaic Singularity」。今回はAppleによるNeuralHash技術の実装とプライバシーの問題について考察します。

■現状では米国のみで適用されるNeuralHash技術

事実の要点を簡単に整理してみます。

AppleがNeuralHash技術の運用を検討しているのは、現在のところ米国内のみです。これは各国の法律や政府からの要請内容が異なるからであり、例えばEUの場合、Facebookを始めとしたオンラインサービスにおいて、児童虐待や児童ポルノに関する画像や情報の検出ツールは、プライベートメッセージの自動監視が禁止されていることから、その運用を禁止されています。

日本においても、通信の秘密に関する法律があることから、通信内容を傍受する形での自動監視や検閲の手段は以前から厳しく制限されており、それを運用しようとして大きな問題となったケースもいくつかあります。

例えば漫画などの違法アップロードサイトへのブロッキング問題が良い例でしょう。2018年に漫画などの違法アップロードサイトや海賊版サイトが野放しとなっていることが大きな問題となり、それに対して日本政府がウェブサイトへの接続を遮断する「サイトブロッキング」を行う方針を決めたのです。

その際、漫画などのアップロードの違法性とは関係なく、サイトブロッキングという手法への批判が相次ぎました。ユーザーの通信内容をプロバイダが監視する形となることから通信の秘密が侵害されるとして、弁護士による提訴にまで発展したのです。

米国に限定するならば、GoogleやMicrosoftなど大手のクラウドサービス運営企業の多くはメールサービスやストレージサービスにおいて、現在すでに違法コンテンツや利用規約に反するデータの検出システムを導入しており、ユーザーデータの監視を行っていることは事実です(日本においては不明)。

つまり、Appleがこれから行おうとしているNeuralHash技術の導入は、こういった他社の流れに迎合するものでありつつも、しかしこれまでAppleがユーザープライバシーの保護を理由に、頑なに抵抗を続けてきた分野でもあるのです。

■NeuralHash導入に見るAppleと米国政府の攻防

これらの点を考慮すると、AppleがこのタイミングでNeuralHash技術を導入する流れとなったのも、むしろプライバシー侵害への強い警戒感故であるという解釈ができます。

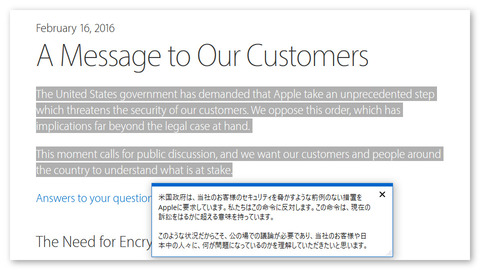

米国政府は以前から、Appleとユーザーデータ(プライバシー情報)の開示について何度も衝突しています。

2016年にはテロの実行犯が使用していたiPhoneのロック解除を巡ってFBIと衝突し、2020年にはAppleがプライバシー保護を優先してiCloudへのフルバックアップをすべて暗号化しようとした際には捜査の障害になるとしてFBIから強く抗議され、やむなく計画を中止するといったような事例も起こっています。

このように米国政府による個人情報への干渉および開示への圧力が相当強かったことは間違いなく、Appleはその圧力へ断固として抵抗しつつも、妥協案として今回のNeuralHash技術の開発に全力を注ぎ、今回の導入へと至ったものと考えるところです。

では、NeuralHashとは具体的にどのような技術なのでしょうか。

・iPhoneなどの端末上からiCloudへアップロードされる画像について、数字や文字列からなる「ハッシュ値」へと変換

・このハッシュ値を、あらかじめNCMECなどからAppleへ提供された児童虐待素材(CSAM)のハッシュ値と比較

・ハッシュ値に合致するものがあった場合に自動的にカウント

・そのカウントが一定の閾値を超えるとNeuralHashがハッシュ値を暗号化しAppleに報告

(ここまでがNeuralHashによる自動作業)

・その報告を基に、Appleが手動で暗号化されたハッシュ値を復号して画像を確認

・その後、問題があると判定された場合にNCMECなどへ報告

このような仕組みと流れになります。

その仕組み上、画像の照合などはすべて不規則な文字列として扱われ、尚且つAppleへ報告されるまでは端末内ですべてが処理されます。つまり、iCloudへのアップロードが行われない限り検閲行為は実行されない仕様です。また、すべての情報は暗号化され、Appleでも閾値を超えて報告されたデータ以外は復号できず、内容を把握できません。

この閾値については不明な点が多くありますが、Appleがプライバシーデータの取り扱いに相当慎重な姿勢である点は伺えます。

例えばGoogle画像検索のように画像データの特徴を直接比較するような方法ではなく、データすべてを無意味な符号に変換し、人間が解読不可能な状態で比較するという非常に回りくどい方法を敢えて取っているからです。

しかも、その照合に用いられるのはNCMECなどから提供されたCSAMのハッシュ値であり、仮に新しい児童虐待画像が作られた(≒新たな児童虐待が発生した)としても、データとは合致しません。

照合の正確性について、Appleは「1兆分の1の確率で誤検出の可能性がある」とし、さらに「アカウントが誤って停止された場合には異議申し立てが可能である」としていますが、この数字を信じるか否かはともかく、既存のデータとの照合に限定しているという点は、Appleがプライバシー保護を最優先としつつも「すでに当局が押収し、明らかに児童虐待として認められたデータと同じであるなら仕方がない」と妥協したギリギリの回答であったと推察されるところです。

■個人と公共の境界線

プライバシーと公共の福祉や安全とのバランスの取り方は、現代社会における大きな課題の1つです。

本連載コラムにおいても、2018年に監視社会の是非を考察する形でテーマとしたことがありましたが、いよいよそれが本格化してきたという印象です。

筆者個人としては、2018年当時から変わらず「個人のプライバシーは何よりも尊重されるべきだが、公共の場においては個人のプライバシーよりも公共の福祉や安全が優先される」という観点は変わっていません。

それ故に、今回のAppleのNeuralHash技術の導入は若干残念に感じつつも、しかし米国政府による強い圧力を考慮すれば致し方のない妥協点であり、Appleはその妥協点に対して数年の時間を掛けて全力でユーザープライバシーの保護を最優先とする手段(技術)を開発してきたのだろうと考えるところです。

【過去記事】秋吉 健のArcaic Singularity:監視社会は果たしてディストピアなのか。IoT技術が支える未来と社会の在り方を考える【コラム】

むしろ個人的には、早々にクラウドサービス内でデータの検閲的行為を実施してきたGoogleやMicrosoftのセキュリティ体制やプライバシー保護への見解が気になるところです。

Appleは今回のNeuralHash技術の導入に際し、その技術情報やチェックに用いられる照合過程をウェブサイトで公開していますが、筆者の情報収集が甘かったせいか、他企業による技術的な情報開示を確認することができませんでした。

こういった情報開示は、個人のプライバシーと公共の福祉および安全とのバランスを取るために必要な行動であると強く感じるところです。

上記で紹介した過去のコラムでは、海外ドラマ「パーソン・オブ・インタレスト」を題材として借用しつつ、個人と公共の境界線について語りました。

かのドラマでは、「マシン」と呼ばれるAIが個人のプライバシーには一切踏み込まず、状況証拠による推論から「この人物が犯罪に関係するかもしれない(加害者なのか被害者なのかも分からない)」という曖昧な情報を主人公たちに提供することで犯罪を抑止していきますが、物語終盤からは、個人のプライバシーを無視して積極的に個人情報へ踏み込み犯罪の証拠を集めることで犯罪抑止を狙う「サマリタン」というAIとの壮絶な戦いが始まります。

今のAppleやGoogle、そして米国政府などの姿を見ていると、このドラマが現実化しているように思えて仕方がないのです。飽くまでも個人情報には踏み込まずに犯罪抑止に努力するのか、それとも個人のプライバシーを侵害してでも積極的に個人情報へ踏み込み犯罪を確実に防いでいくのか。

筆者はやはり「マシン」派です。例え犯罪者が対象であったとしても、個人のプライバシーを侵害してまで検閲行為や監視行為を行うことは人権の見地から許されざるものです。犯罪の抑止や公共の安全の確保とは、個人の権利を侵害しない範囲で最大限の努力が行われるべきことだと考えます。

AIを始めとしたテクノロジーとは、本来そういった努力のために利用されるべきものではないでしょうか。人が介在できない領域、人が踏み込んではいけない領域があるからこそ、その外側からのアプローチを高度化していく必要があると、強く考えるところです。

■関連リンク

・エスマックス(S-MAX)

・エスマックス(S-MAX) smaxjp on Twitter

・S-MAX – Facebookページ

・連載「秋吉 健のArcaic Singularity」記事一覧 – S-MAX

コメント